В современном информационном обществе, где технологии развиваются в геометрической прогрессии, кибербезопасность становится одной из наиболее актуальных и важных проблем. Распространение искусственного интеллекта (ИИ) внесло значительные изменения в эту область, создавая новые угрозы и вызывая необходимость разработки мер по их предотвращению.

Искусственный интеллект обладает высоким потенциалом в сфере кибербезопасности и может использоваться для обнаружения и предотвращения атак, анализа уязвимостей и дешифрования шифровальщиков. Однако, в то же время, ИИ может стать новой угрозой, так как злоумышленники могут использовать его для усовершенствования и автоматизации своих атак.

Среди главных угроз, связанных с искусственным интеллектом, можно выделить автоматизированные атаки, масштабное фишинг-мошенничество, манипуляции с машинным обучением и утечки данных. Для противодействия этим угрозам необходимо разработать соответствующие меры безопасности, включающие в себя обучение искусственного интеллекта обнаружению и предотвращению атак, создание защищенных алгоритмов и архитектур ИИ, а также повышение осведомленности пользователей о возможных угрозах и методах их предотвращения.

- Кибербезопасность и искусственный интеллект: взаимосвязь и риск

- Влияние искусственного интеллекта на кибербезопасность

- Угрозы, связанные с развитием искусственного интеллекта в сфере кибербезопасности

- Меры защиты от кибератак, основанные на искусственном интеллекте

- Вопрос-ответ:

- Что такое кибербезопасность и почему она важна?

- Как искусственный интеллект влияет на кибербезопасность?

- Какие основные угрозы связаны с кибербезопасностью?

- Какие угрозы представляют искусственный интеллект и кибербезопасность?

- Какие меры противодействия существуют для защиты от киберугроз и искусственного интеллекта?

- Видео:

- ПОЧЕМУ голосовые помощники не хотят говорить, кто такой Иисус?

Кибербезопасность и искусственный интеллект: взаимосвязь и риск

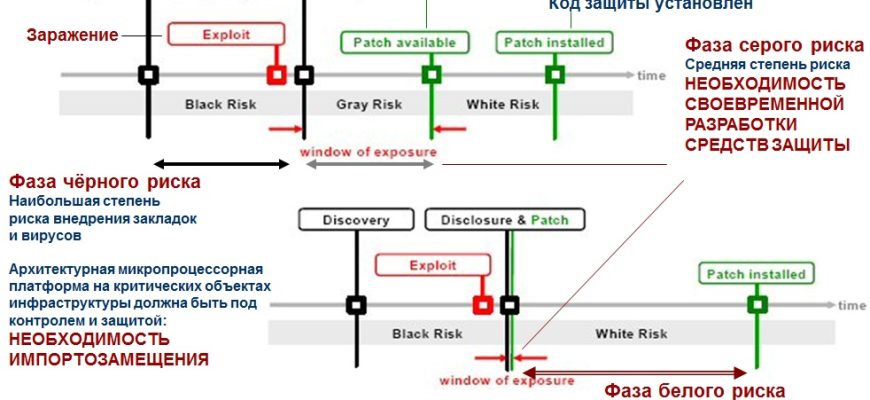

Однако, использование искусственного интеллекта в кибербезопасности может быть сопряжено с определенными рисками. Злоумышленники могут искусственно «подтравить» систему искусственного интеллекта, внедрив в нее вредоносные данные или изменяя обучающие выборки. Это может привести к ошибочным решениям и ложным срабатываниям, которые могут оказаться гораздо более опасными, чем сама атака. Кроме того, использование искусственного интеллекта в кибербезопасности требует больших вычислительных мощностей и затратных инвестиций, что делает его недоступным для всех организаций и пользователей.

В целом, взаимосвязь между кибербезопасностью и искусственным интеллектом представляет собой сложную дилемму, требующую баланса между эффективностью защиты и рисками. Полноценное и безопасное использование искусственного интеллекта в кибербезопасности возможно только при разработке соответствующих алгоритмов и строгих мер по предотвращению атак на системы искусственного интеллекта.

| Преимущества использования искусственного интеллекта в кибербезопасности: | Риски использования искусственного интеллекта в кибербезопасности: |

|---|---|

| — Выявление аномальных активностей с высокой степенью точности | — Внедрение вредоносных данных или изменение обучающих выборок |

| — Автоматизация процессов реагирования на инциденты | — Ошибочные решения и ложные срабатывания |

| — Прогнозирование потенциальных угроз | — Высокие вычислительные мощности и затратные инвестиции |

Влияние искусственного интеллекта на кибербезопасность

Одной из основных областей, где применяются ИИ в кибербезопасности, является мониторинг и обнаружение аномального поведения. ИИ-алгоритмы могут анализировать большие объемы данных и выявлять аномалии, которые могут свидетельствовать о кибератаке. Это позволяет сократить время реакции на инцидент и своевременно принять меры по предотвращению угрозы.

Использование ИИ также помогает в создании более защищенных систем. Алгоритмы машинного обучения позволяют выявлять уязвимости и предлагать оптимальные решения по их устранению. Это особенно актуально для сложных и разветвленных сетей, где обычные подходы к безопасности часто оказываются недостаточными.

Однако, развитие ИИ также создает новые угрозы для кибербезопасности. Распространение умных ботов и автоматизированных атак, использующих ИИ-технологии, позволяет злоумышленникам проводить масштабные и сложные кибератаки. ИИ может использоваться для генерации фишинговых и спам-сообщений, маскировки вредоносного программного обеспечения и осуществления утечки данных.

Кроме того, ИИ может быть использован в целях социальной инженерии, например, для симуляции человеческого поведения и обмана пользователей. Алгоритмы ИИ могут анализировать и синтезировать информацию о целях и интересах людей, что делает их более уязвимыми для фишинговых атак и манипуляции.

| Искусственный интеллект может использоваться для укрепления кибербезопасности, однако его неправильное использование может привести к большим угрозам и рискам. |

Проблема кибербезопасности в условиях развития искусственного интеллекта требует внимательного и комплексного подхода. Необходимо систематически исследовать новые угрозы и разрабатывать соответствующие методы и технологии для защиты информационных систем от кибератак. Расширение искусственного интеллекта в области кибербезопасности должно сопровождаться повышением осведомленности и обучением пользователей, чтобы они могли определить и предотвратить возможные угрозы.

Угрозы, связанные с развитием искусственного интеллекта в сфере кибербезопасности

Развитие искусственного интеллекта (ИИ) в сфере кибербезопасности предоставляет множество новых возможностей, но также вызывает серьезные угрозы. Использование ИИ в кибербезопасности может привести к появлению более сложных и неуловимых атак, чем это было ранее. В этом разделе рассмотрим основные угрозы, связанные с развитием искусственного интеллекта в сфере кибербезопасности.

1. Автоматизация атак – использование машинного обучения и алгоритмов искусственного интеллекта позволяет злоумышленникам автоматизировать процесс интеллектуальных атак на информационные системы. Атакующие могут создавать и обучать алгоритмы, способные быстро анализировать и перебирать возможные слабые места, обходить системы обнаружения и внедряться в защищенные сети.

2. Генерация мошеннического контента – развитие искусственного интеллекта позволяет создавать все более реалистичный мошеннический контент, такой как фейковые фотографии, видеозаписи и голосовые сообщения. Это создает новые возможности для фишинга и социальной инженерии, когда киберпреступники могут использовать ИИ для создания подлинно выглядящего контента, чтобы обмануть пользователей и получить доступ к их личным данным или сетевым ресурсам.

3. Атаки на алгоритмы ИИ – искусственный интеллект может быть уязвим к атакам самого ИИ. Злоумышленники могут использовать методы регуляризации, атаки с помощью ввода данных или другие приемы, чтобы исказить работу алгоритмов ИИ и заставить их принимать неправильные решения. Такие атаки могут быть особенно опасными, если ИИ используется для принятия важных решений, например, в системах автономного вождения или в финансовой сфере.

4. Атаки на системы обучения ИИ – злоумышленники могут попытаться внедриться в системы обучения искусственного интеллекта, чтобы искажать данные или вмешиваться в процесс обучения. Это может повлиять на качество моделей ИИ и заставить систему принимать неправильные решения. Например, атака на систему обучения ИИ для автоматического обнаружения вирусов может привести к тому, что ИИ перестанет распознавать новые виды вредоносных программ.

5. Угроза от обратного инжиниринга ИИ – развитие ИИ может повысить возможности для обратного инжиниринга. Атакующие могут попытаться изучить модели ИИ и выявить слабые места или уязвимости, чтобы использовать их против системы. Это может быть особенно опасно, если ИИ используется для защиты критически важных систем или передачи конфиденциальной информации.

| Угроза | Описание | Примеры |

|---|---|---|

| Автоматизация атак | Использование машинного обучения и алгоритмов ИИ для автоматизации интеллектуальных атак | Создание алгоритма, способного обнаруживать и эксплуатировать уязвимости в сети |

| Генерация мошеннического контента | Создание подлинно выглядящего мошеннического контента с помощью ИИ | Создание фейкового видео с участием известных личностей |

| Атаки на алгоритмы ИИ | Искажение работы алгоритмов ИИ, чтобы принять неправильные решения | Использование методов ввода данных для искажения результатов классификации |

| Атаки на системы обучения ИИ | Внедрение в обучающие данные или вмешательство в процесс обучения | Добавление искаженных данных в набор обучающих примеров |

| Угроза от обратного инжиниринга ИИ | Изучение моделей ИИ для выявления слабых мест или уязвимостей | Анализ модели ИИ для выявления алгоритма защиты |

Угрозы, связанные с развитием искусственного интеллекта в сфере кибербезопасности, требуют постоянного развития и совершенствования методов защиты. Необходимо принимать серьезные меры для обеспечения безопасности систем, использующих ИИ, и разработки новых методов обнаружения и противодействия угрозам.

Меры защиты от кибератак, основанные на искусственном интеллекте

Современные угрозы в сфере кибербезопасности стали все более сложными и совершенными. Для эффективной защиты от таких угроз требуются современные и инновационные подходы, способные предсказывать и анализировать новые способы атаки и принимать соответствующие меры противодействия.

В этой связи искусственный интеллект становится незаменимым инструментом в борьбе с кибератаками. Благодаря своим возможностям по обработке и анализу больших объемов данных, искусственный интеллект может быть использован для обнаружения и предотвращения атак на ранних стадиях.

Алгоритмы машинного обучения и нейронные сети позволяют искусственному интеллекту обучаться на основе исторических данных, выявлять аномалии и необычное поведение, а также идентифицировать новые угрозы, для которых паттерны атак еще не известны.

Искусственный интеллект также может использоваться для автоматического анализа и фильтрации сетевого трафика, анализа e-mail сообщений и обнаружения вредоносных программ. Благодаря этому, возможно реагировать на угрозы реального времени и максимально сократить время реакции на инциденты.

Однако, следует помнить, что искусственный интеллект не является универсальным решением и не может полностью заменить человеческий фактор. Поэтому важно создать синергию между искусственным интеллектом и специалистами по кибербезопасности, чтобы обнаруживать и пресекать новые угрозы с помощью новейших технологий и быстро принимать меры по защите от них.

Вопрос-ответ:

Что такое кибербезопасность и почему она важна?

Кибербезопасность — это область знаний и практик, которые направлены на защиту компьютерных систем, сетей и данных от несанкционированного доступа, вредоносного программного обеспечения и других киберугроз. Она важна, потому что с ростом использования информационных технологий и сетевых коммуникаций, угрозы кибербезопасности стали все более серьезными и распространенными. Нарушители имеют возможность получить доступ к чувствительным данным, вызвать проблемы в работе компьютерных систем, и даже нанести ущерб реальной инфраструктуре.

Как искусственный интеллект влияет на кибербезопасность?

Искусственный интеллект играет двойственную роль в кибербезопасности. С одной стороны, он может использоваться для улучшения и расширения возможностей защиты информации, автоматизации процессов обнаружения и реагирования на кибератаки, а также анализа потенциальных уязвимостей. С другой стороны, злоумышленники также могут использовать искусственный интеллект для разработки и автоматизации кибератак, что создает новые вызовы для кибербезопасности.

Какие основные угрозы связаны с кибербезопасностью?

Основные угрозы кибербезопасности включают в себя: вирусы, черви и троянские программы, которые могут заразить компьютеры и сети; хакеры и злоумышленники, которые могут получить несанкционированный доступ к компьютерам и данным; фишинг и фишинг-атаки, которые направлены на получение чувствительной информации, такой как пароли и номера банковских карт; сетевые атаки и отказ в обслуживании, которые могут привести к проблемам в работе компьютерных систем и сетей; и кражу или утрату данных, которая может привести к утечке важной информации.

Какие угрозы представляют искусственный интеллект и кибербезопасность?

Искусственный интеллект может быть использован для создания и распространения вредоносных программ, атак на компьютерные системы, фишинга и кражи данных. Кибербезопасность подвергается угрозам со стороны хакеров, киберпреступников и государственных акторов.

Какие меры противодействия существуют для защиты от киберугроз и искусственного интеллекта?

Для защиты от киберугроз необходимо использовать сильные пароли, устанавливать обновления программного обеспечения, использовать антивирусное ПО и брандмауэры. В случае использования искусственного интеллекта в кибератаках, необходимо разрабатывать и внедрять алгоритмы обнаружения и предотвращения таких атак.